Mistral Forge: der neue Run auf eingebettetes Unternehmenswissen

Mistral hat heute Forge angekündigt, und für mich ist das nicht einfach das nächste KI-Produkt. Für mich markiert das einen entscheidenden Richtungswechsel.

Wenn man es auf eine einfache Analogie runterbrechen will: Jedes KI-Modell hat so etwas wie ein Langzeitgedächtnis und ein Kurzzeitgedächtnis. Was es beim Training gelernt hat, sitzt tief. Was man ihm zur Laufzeit mitgibt, per Prompt, per RAG, per Tool-Zugriff, das ist Arbeitsgedächtnis. Nützlich, aber flüchtig. Die letzten zwei Jahre haben wir fast ausschließlich am Kurzzeitgedächtnis optimiert. Mistral sagt mit Forge: Wir sollten mal über das Langzeitgedächtnis reden.

Das Kontextversprechen

Das Rennen lief die letzten zwei Jahre ziemlich klar in eine Richtung: größere Kontextfenster, besseres Retrieval, bessere Needle-in-a-Haystack-Werte. Die Hoffnung dahinter war simpel. Wenn wir dem Modell nur genug internen Kontext mitgeben, wird daraus schon ein brauchbarer Agent für die Firma.

Ich glaube, genau diese Hoffnung stößt gerade an ihre Grenze.

Gesammeltes Unternehmenswissen sprengt jedes noch so große Kontextfenster um Größenordnungen. In großen Organisationen reden wir nicht über ein Handbuch und ein paar Policies. Wir reden über zehntausende Wiki-Seiten, Tickets, Runbooks, PDFs, Codebasen, Architekturentscheidungen und alte Sonderfälle. Und dann kommt noch der unangenehm wichtige Teil dazu, der nirgends sauber steht: das Wissen in den Köpfen, die Kultur, die impliziten Regeln, die Abkürzungen, die stillschweigenden Ausnahmen.

Genau da liegt der eigentliche Knackpunkt. Modelle sind auf Internetwissen trainiert. Unternehmen arbeiten aber auf Firmenwissen. Das Modell hat das eine im Langzeitgedächtnis, bräuchte aber das andere.

Vielleicht ist das auch der Grund, warum Einzelpersonen gerade so viel leichter agentisch arbeiten als Teams in Organisationen. Mein Kontext passt noch in ein Gespräch. Meine Projekte, meine Begriffe, meine Werkzeuge, das ist überschaubar. Mit einer guten Memory Bank oder einem sauber gepflegten Projektkontext komme ich erstaunlich weit. Eine Organisation mit zehntausend Mitarbeitern hat aber keinen persönlichen Kontext. Sie hat ein ganzes Universum davon. Und dort soll KI nicht nur hilfreich sein, sondern verlässlich. Sie soll die Sprache der Firma sprechen, interne Begriffe sauber verwenden, mit echten Systemen umgehen, Freigabewege respektieren und an den Stellen vorsichtig sein, an denen man von außen gar nicht erkennt, dass Vorsicht nötig ist. Ein generisches Modell ist auf Durchschnitt trainiert. Unternehmen brauchen aber gerade keinen Durchschnitt.

Bisher versuchen viele Teams, diese Lücke zur Laufzeit zu stopfen. Noch ein Prompt. Noch ein RAG-Layer. Noch ein MCP-Server. Noch mehr Dokumente im Kontext. Das kann funktionieren. Aber es bleibt oft fragil, teuer und instabil, sobald der Kontext groß, widersprüchlich oder einfach nur unordentlich wird. Alles Kurzzeitgedächtnis. Bei jedem Lauf neu zusammengesteckt, bei jedem Lauf neu anfällig.

Vom Kontext ins Modell

Mit Mistral Forge beginnt für mich deshalb ein neuer Run. Nicht mehr nur: Wie stopfen wir mehr Wissen in das Kurzzeitgedächtnis? Sondern: Wie bringen wir Unternehmenswissen ins Langzeitgedächtnis des Modells?

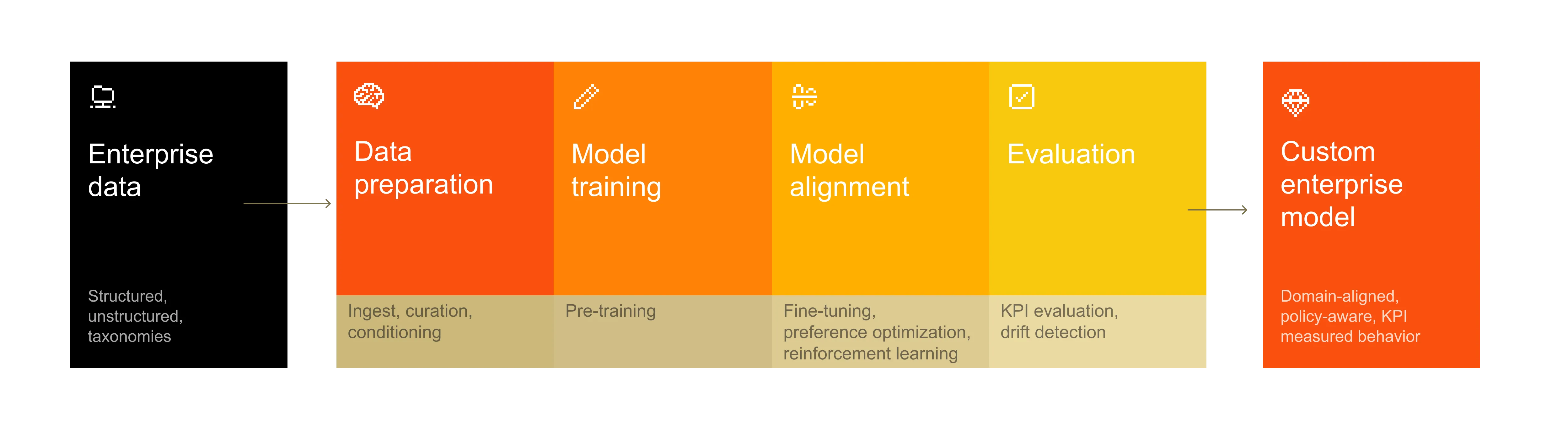

Mistral beschreibt Forge als System, mit dem Unternehmen eigene frontier-taugliche Modelle auf Basis ihres proprietären Wissens bauen können. Nicht nur per Prompt. Nicht nur per RAG. Sondern über drei Wege, die alle am Langzeitgedächtnis ansetzen: neues Grundwissen aufbauen, gezieltes Verhalten trainieren und über Feedback-Schleifen nachschärfen.

Ganz neu ist die Logik dahinter nicht. Wir haben längst Spezialmodelle gesehen. Coding-Modelle zum Beispiel, die bewusst für Codegenerierung, Tool Use und Repo-Arbeit optimiert wurden. Die wissen nicht nur, was Code ist. Die haben verinnerlicht, wie man in einer Codebase arbeitet. Forge zieht dieselbe Idee jetzt auf eine andere Ebene. Nicht Code als Spezialdomäne, sondern das Innenleben eines Unternehmens. Mit dem Unterschied, dass öffentlicher Code in rauen Mengen existiert, während proprietäres Firmenwissen oft dünn, unstrukturiert und verstreut ist.

Nicht nur Wissen, auch Maßstäbe

Und hier wird es für mich richtig interessant. Forge ist nicht nur ein Wissensproblem. Es ist auch ein Alignment-Problem. Denn ein Unternehmen muss nicht nur Daten ins Langzeitgedächtnis eines Modells bringen. Es muss auch wissen, woran es gute Antworten überhaupt erkennt. Welche Trade-offs gelten. Wo harte Grenzen liegen. Wann Geschwindigkeit zählt und wann Vorsicht wichtiger ist.

Forge verbindet deshalb Training mit internen Evals, Policies und operativen Zielen. Wissen ins Modell zu bringen ist die eine Sache. Dem Modell beizubringen, wie die Organisation gute Ergebnisse von schlechten unterscheidet, ist die andere. Wenn diese Dinge im Unternehmen nicht klar sind, rettet auch das beste Custom-Modell nichts.

Die bisherige Kontextlogik war deshalb nicht falsch, nur als alleinige Strategie zu klein gedacht. Wenn Mistral das ernst meint, dann ist Forge nicht Fine-Tuning unter neuem Namen. Dann ist das der Versuch, Organisationswissen, Bewertungsmaßstäbe und interne Zwänge tiefer im Verhalten des Modells zu verankern, statt sie bei jedem Lauf als Kurzzeitgedächtnis neu hineinzuschieben.

Für Code-Agenten wird das besonders greifbar. Die meisten gewachsenen Systeme in Unternehmen haben keine saubere Spezifikation. Das System selbst ist die Spezifikation, mit all seinen alten Entscheidungen, impliziten Konventionen und Sonderfällen. Wenn ein Agent dort mehr sein soll als ein schneller Textgenerator, muss er mehr verstehen als öffentliche Best Practices.

Kein Checkpoint für Kultur

Natürlich ist das trotzdem keine Wunderlösung. Nicht jedes relevante Firmenwissen lässt sich sauber in Trainingsdaten verwandeln. Ein Teil davon ist gelebtes Urteil. Ein Teil davon ist stillschweigende Abstimmung zwischen Menschen, die seit Jahren miteinander arbeiten. Das bekommt man nicht einfach in einen Checkpoint gebrannt. Und wer glaubt, man könne 20 Jahre gewachsene Organisationskultur in eine Trainings-Pipeline kippen und am Ende kommt ein Modell raus, das die Firma versteht, der unterschätzt das Problem. Manche Dinge bleiben im Kurzzeitgedächtnis besser aufgehoben, weil sie sich zu schnell ändern oder zu sehr von Kontext abhängen. Training und Kontext werden sich ergänzen, nicht ersetzen.

Ich lese Forge deshalb nicht als weiteres Modell-Announcement, sondern als Signal: Das Problem ist immer seltener, dass Modelle zu dumm sind. Das Problem ist, dass sie zu wenig von der Organisation wissen, in der sie arbeiten sollen. Große Kontextfenster waren dafür eine brauchbare Krücke. Mehr aber auch nicht.

Spannend wird es jetzt an einer viel unromantischeren Stelle. Nicht bei der Frage, welches Frontier-Modell diese Woche ein paar Benchmarks mehr schafft. Sondern bei der Frage, ob Unternehmen ihr eigenes Wissen überhaupt in eine Form bringen, die ein Modell lernen, ein Agent ausführen und ein Betrieb verantworten kann.

Wenn Forge etwas zeigt, dann das: Firmenwissen wird langsam von einem Dokumentationsproblem zu einem Modellierungsproblem.

Und ich vermute, genau dort wird sich in den nächsten Monaten und Jahren entscheiden, welche Unternehmen mit Agenten wirklich produktiver werden und welche nur sehr teure Demos bauen.